原文連結:ChatGPT使い方総まとめ - Qiita

這篇文章主要介紹現在正流行的 ChatGPT,整理幾項不論是日常或在工作上,都很實用的提問方式。作者是 sakasegawa。

使用方法分類如下:

- 文章範例

- 提問-回答

- 創作 Wikipedia 風格的文章

- 建立任務列表

- 建立時間表

- 歸納

- 將列點用文章呈現

- 將文章列點呈現

- 程式碼

- 生成程式碼

- 生成程式碼的文件

- 重構

- 單元測試

- DB 設計(資料庫設計)

- 故事範例

- 語氣變化

- 模仿角色的語氣來回答

以下正文開始。

ChatGPT 是什麼

這是一款基於 OpenAI,並以令人驚嘆的語言模型 GPT-3(※) 為基底,所開發的聊天應用程式,能夠立即回答任何問題。

本文將介紹各種使用方法。

※ 確切來說,是被稱為 GPT-3.5 系列

https://chat.openai.com/

順帶一提,關於 GPT-3,以下 note 的文章也很有用,有興趣也可參考:

AIがコミットメッセージ自動生成!神ツール『auto-commit』『commit-autosuggestions』の紹介

ChatGPTの仕組みを考えながらプロンプトを作る手法はこちらに別途まとめています

使用範例

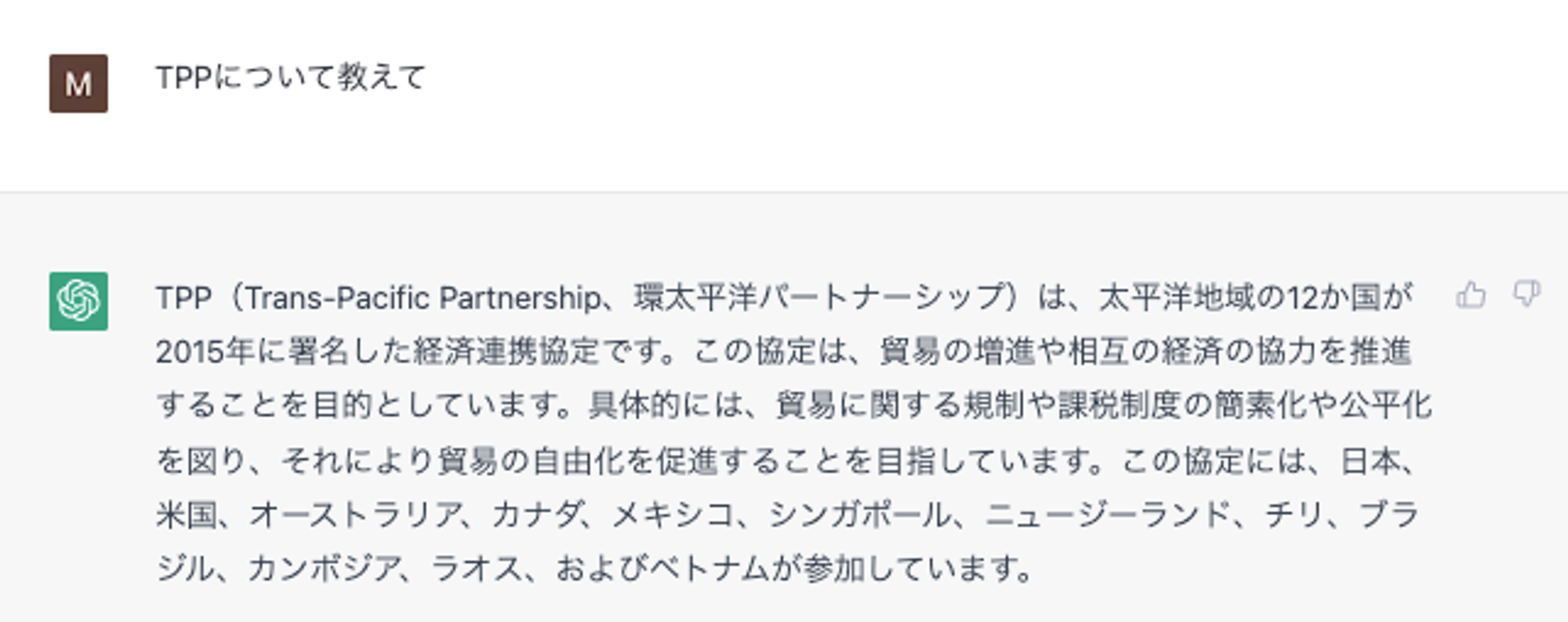

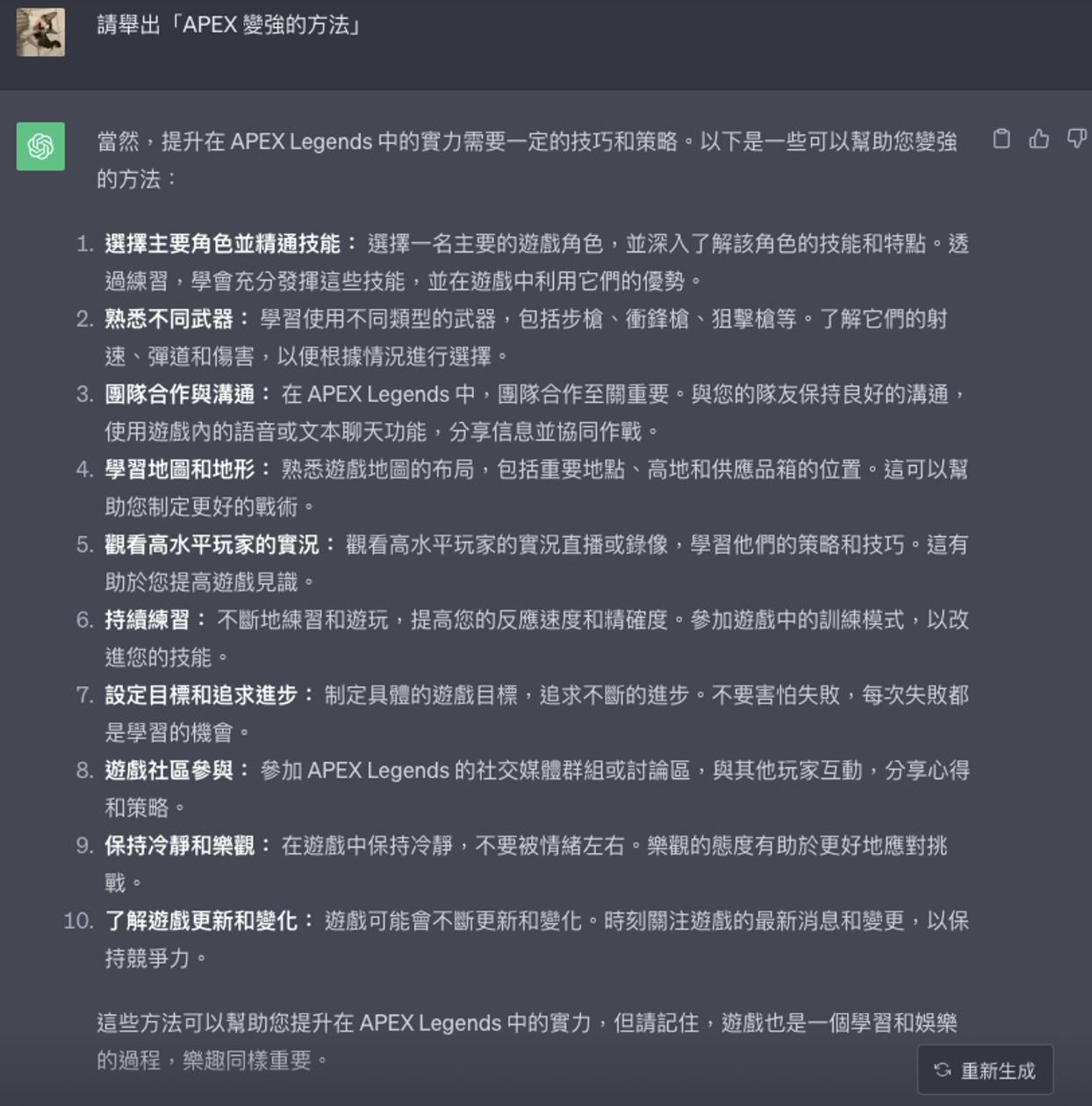

提問-回答

1 | 〜について教えて |

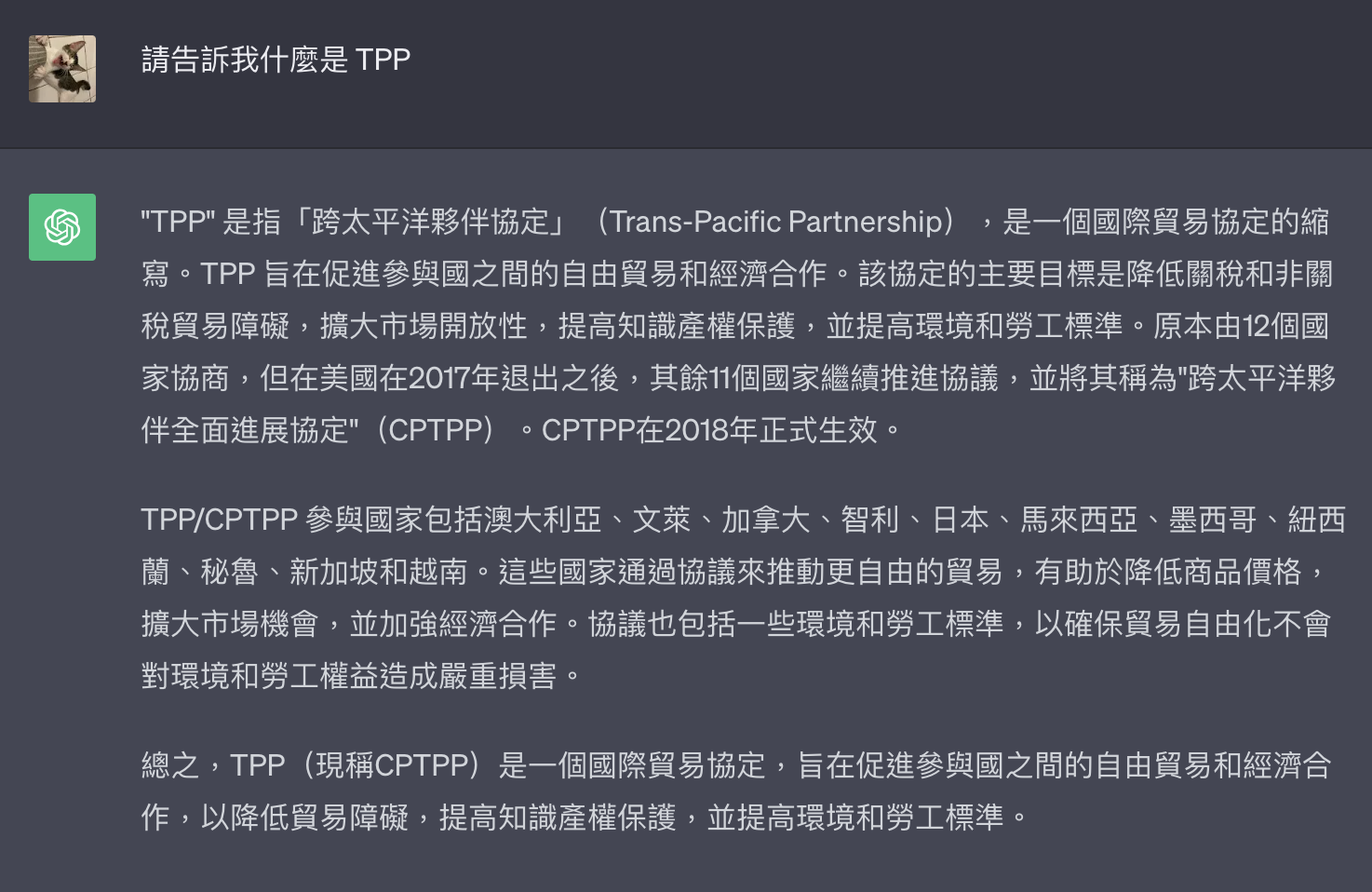

以下是中文版本:

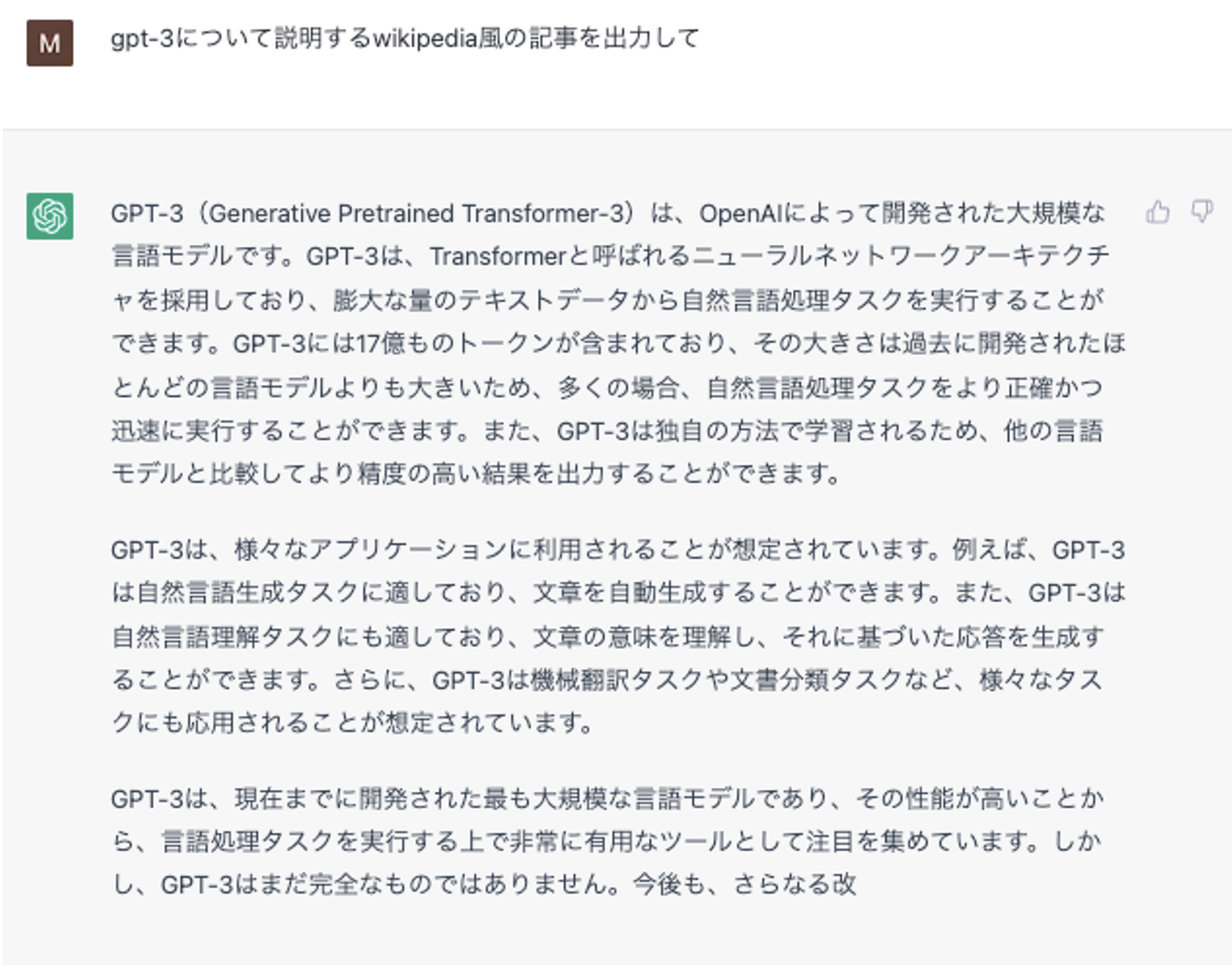

創作 Wikipedia 風格的文章

1 | 〜について説明するWikipedia風の記事を出力して |

以下是中文版本:

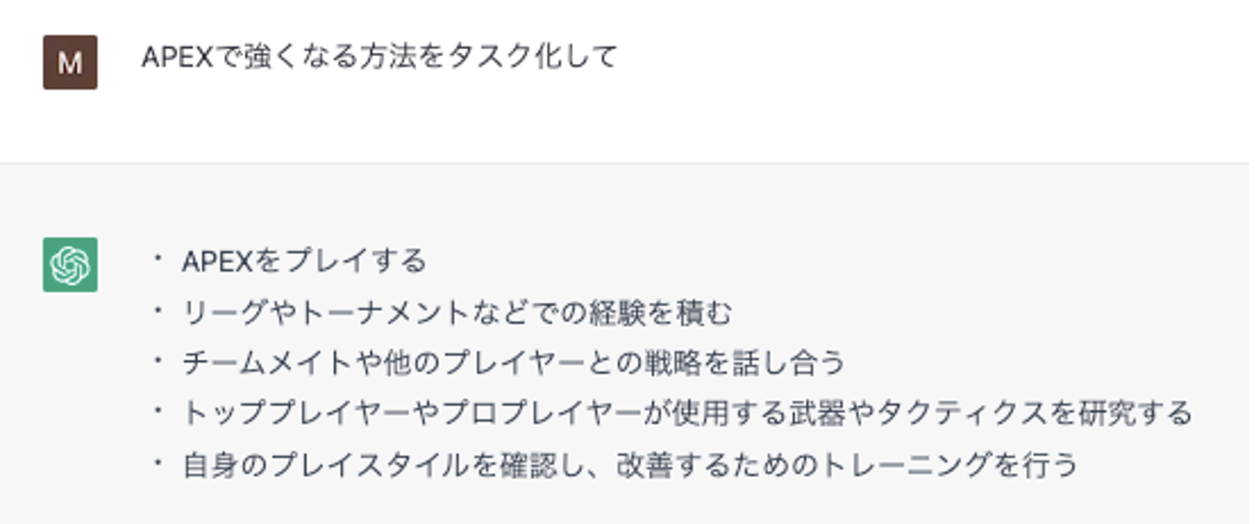

建立任務列表

1 | 〜をタスク化して |

以下是中文版本,發現如果用「任務化」步驟會太詳細,因此換個方式問:

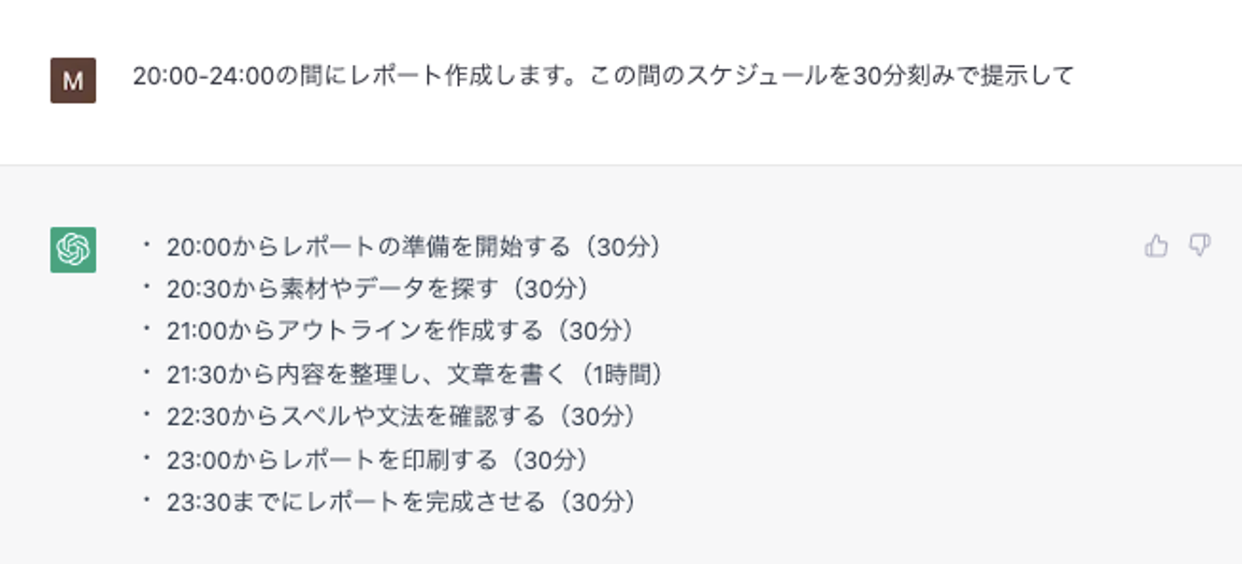

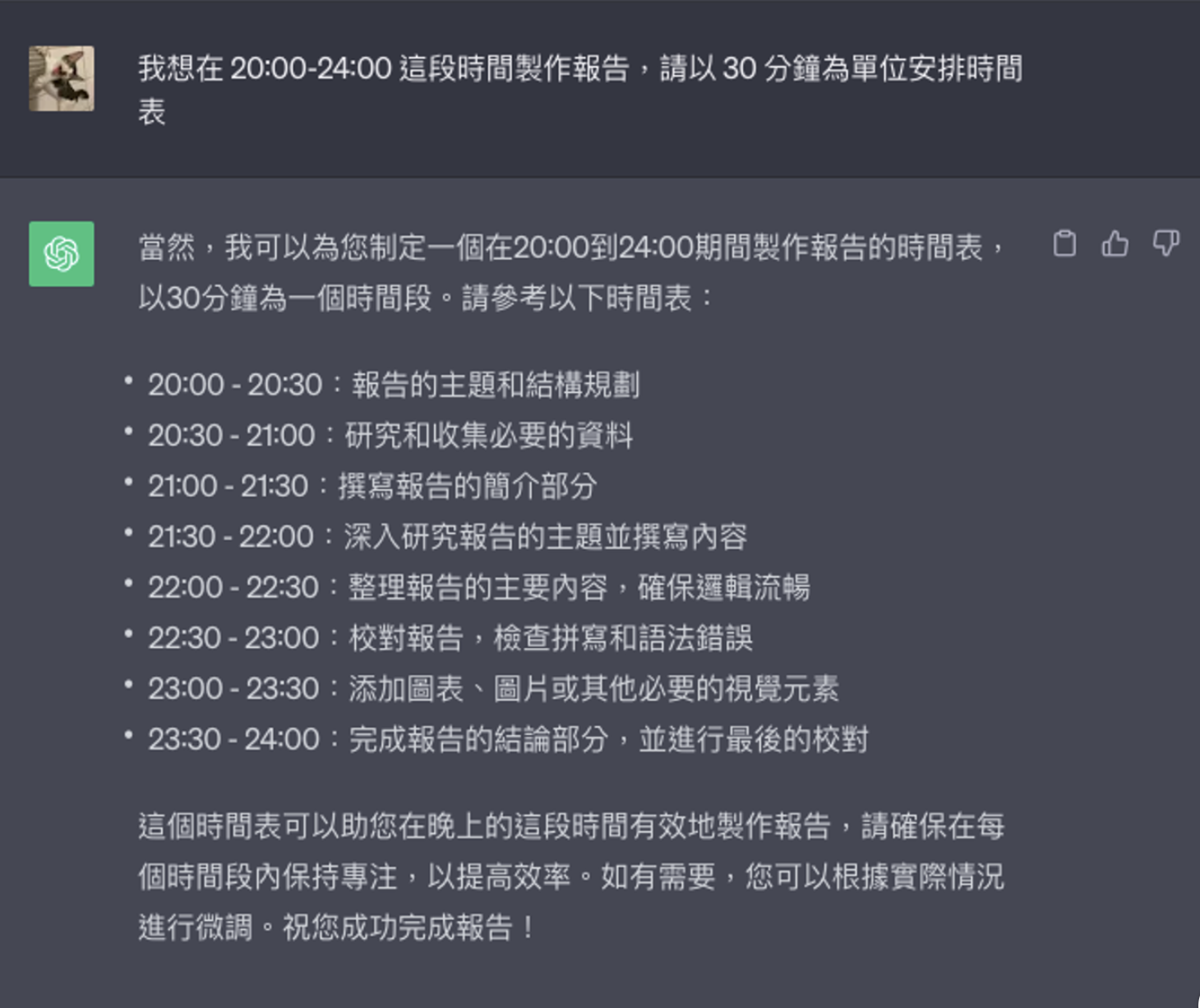

建立時間表

1 | xx〜yyの間にzzします。この間のスケジュールを30分刻みで提示して |

以下是中文版本:

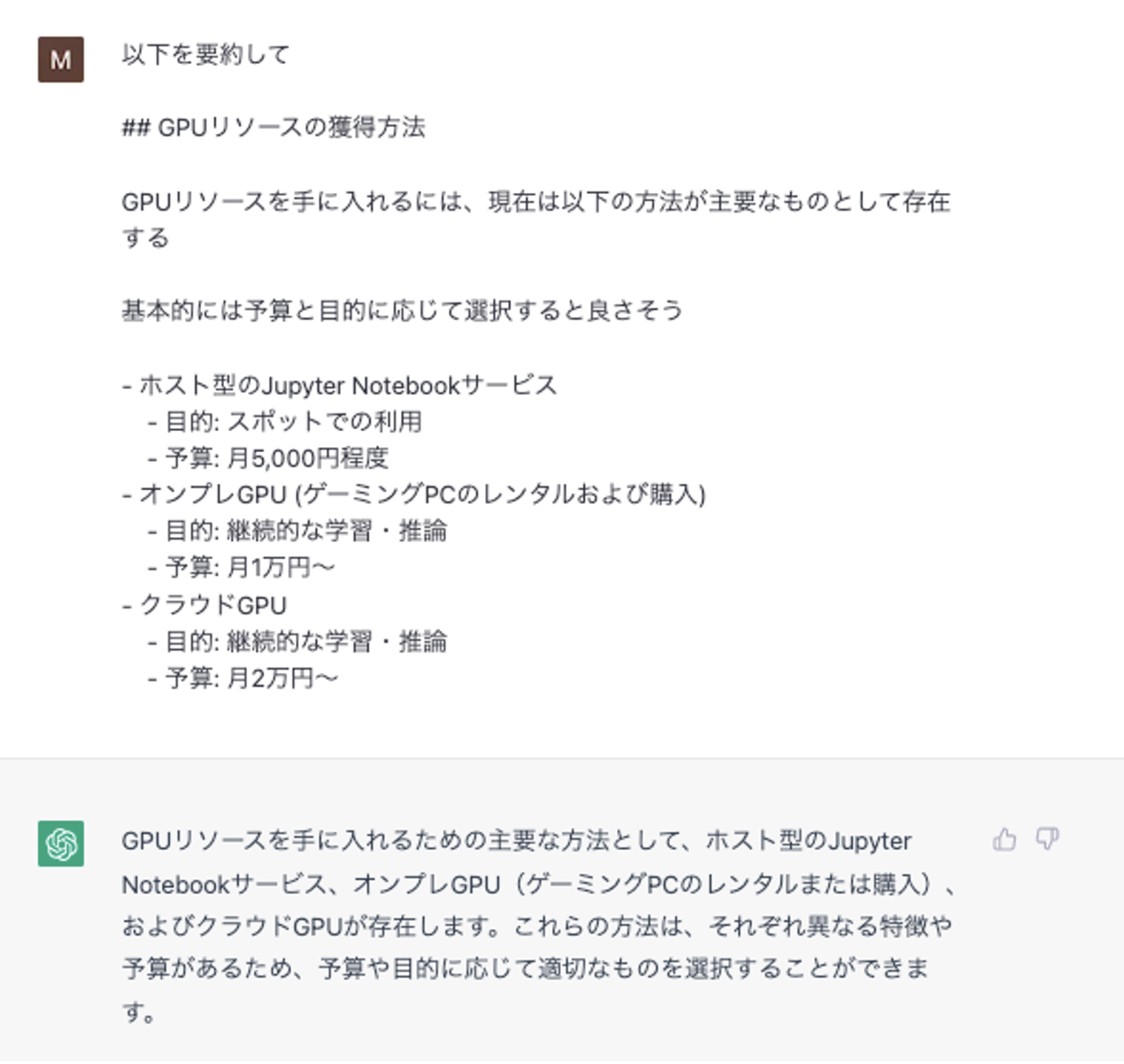

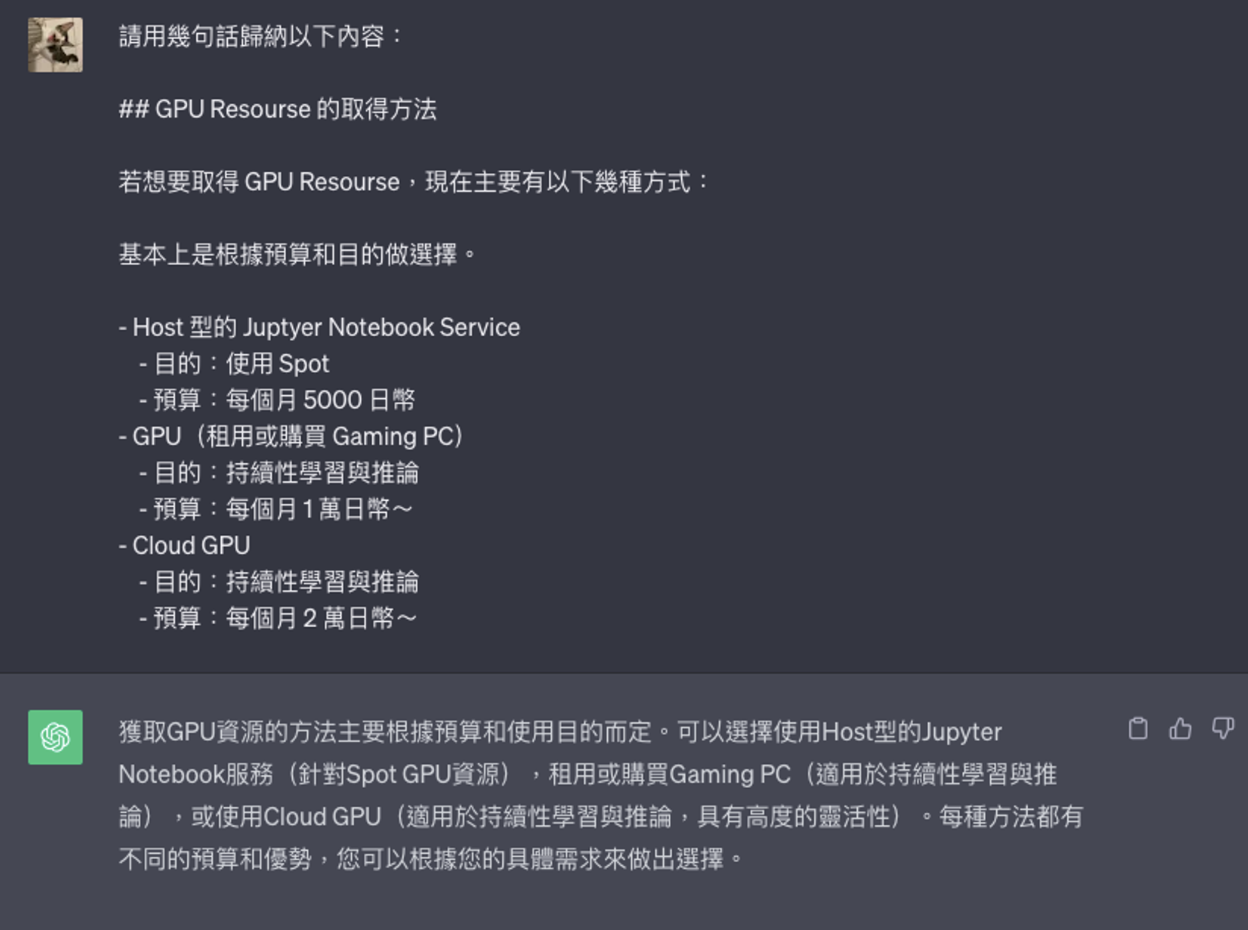

歸納

1 | 以下を要約して |

以下是中文版本,這裡意外發現如果沒有加上「幾句話」,會一直鬼打牆用列點的方式回答,因此還是要確實指定希望的格式:

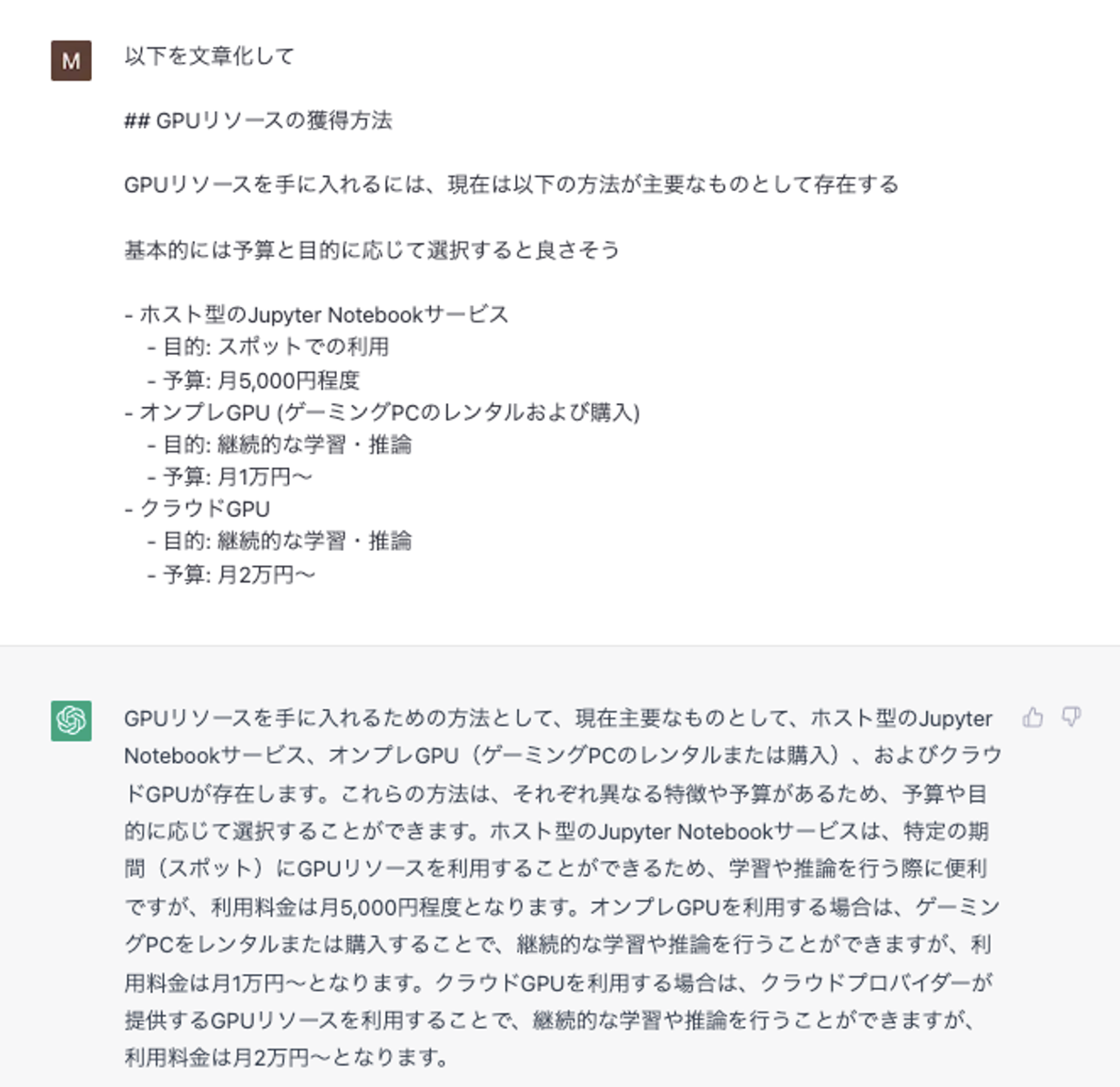

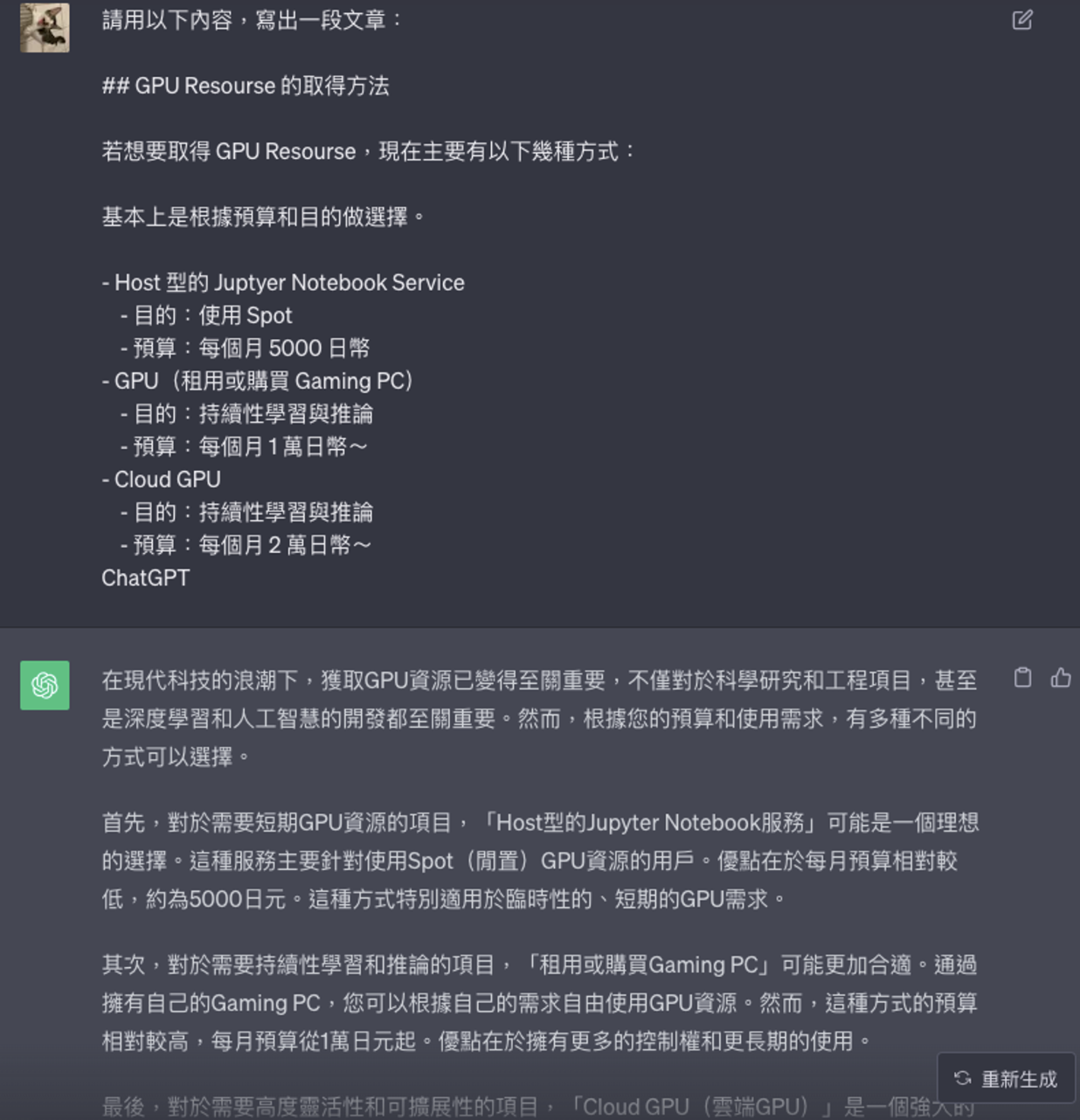

將列點用文章呈現

1 | 以下を文章化して |

以下是中文版本:

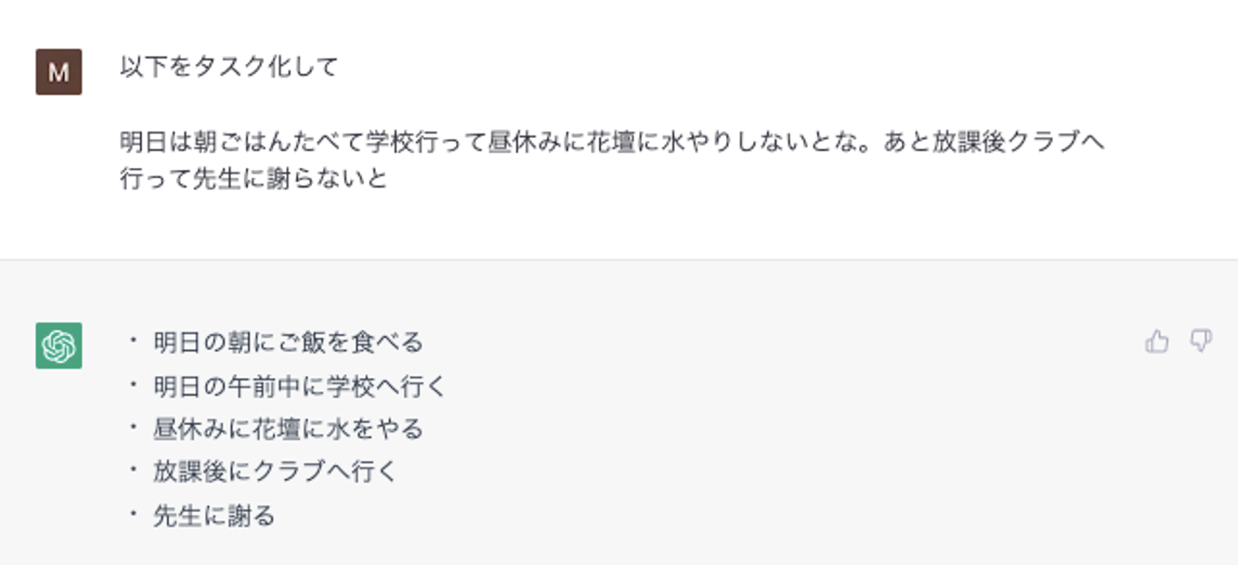

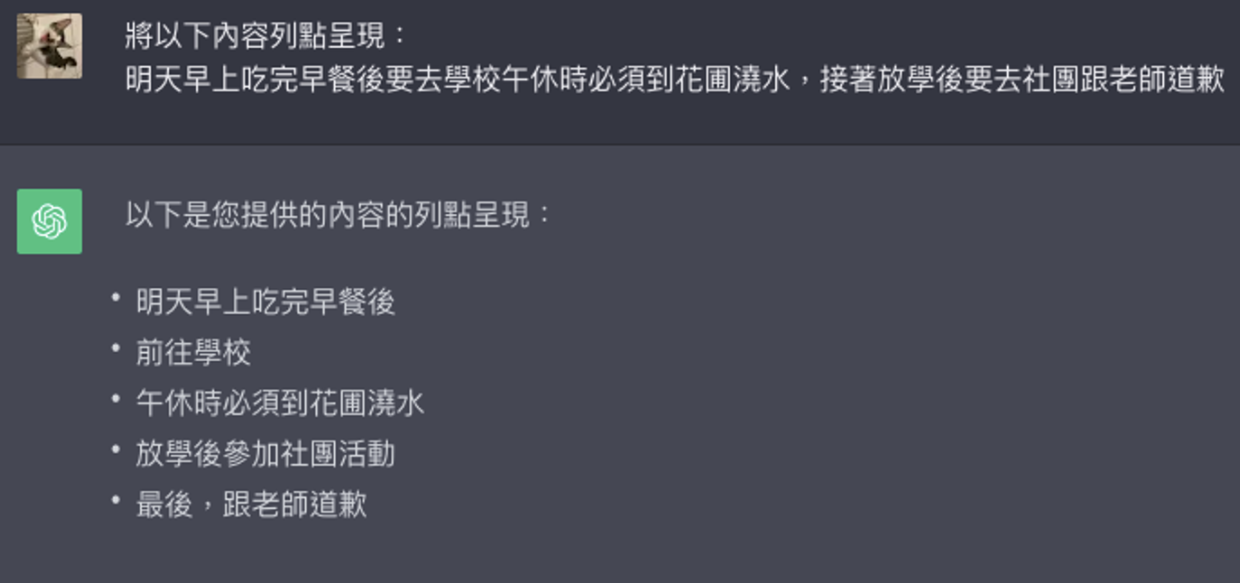

將文章列點呈現

1 | 以下をタスク化して |

以下是中文版本:

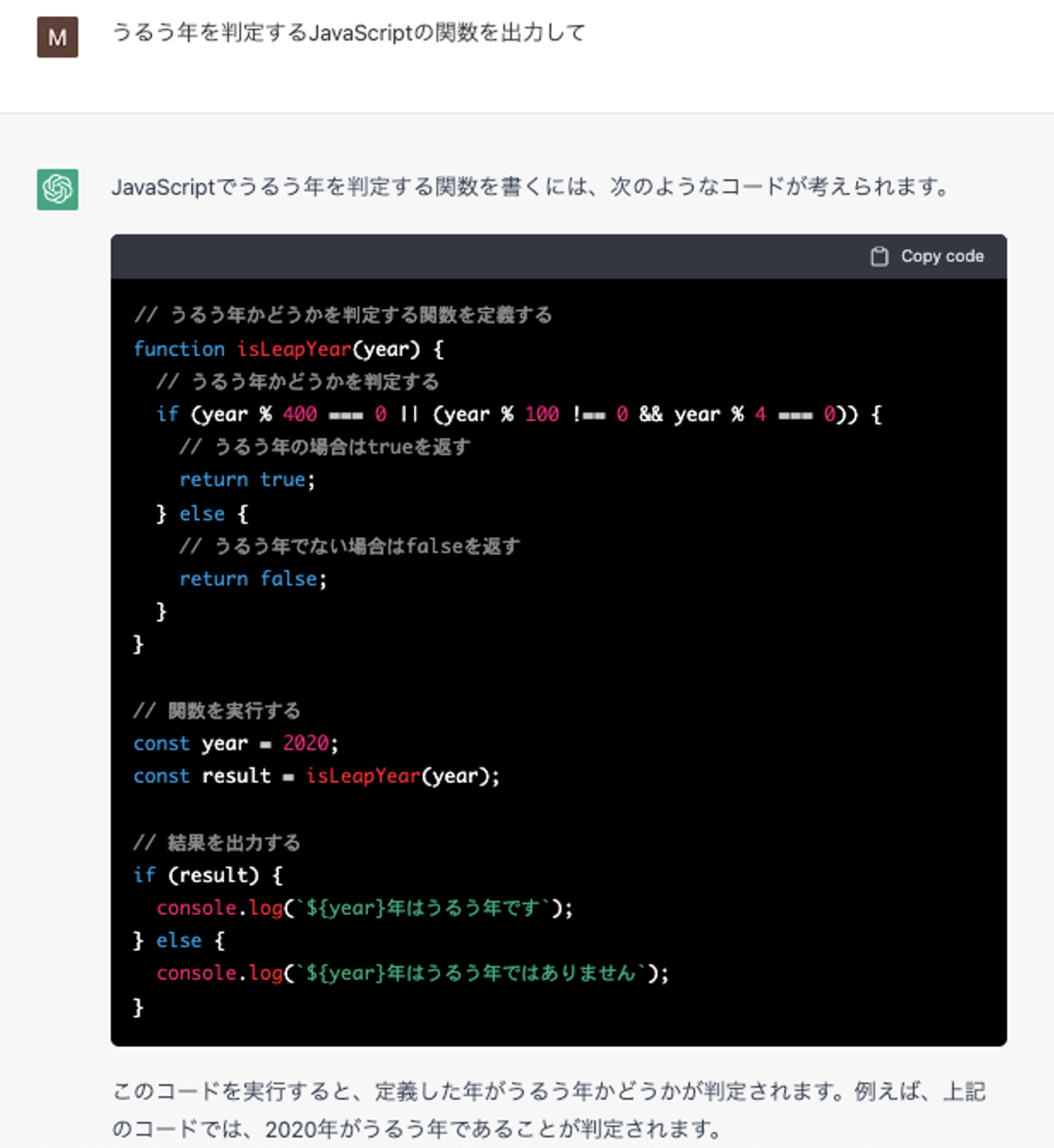

程式碼

生成程式碼

1 | xxするyyの関数を出力して |

以下是中文版本:

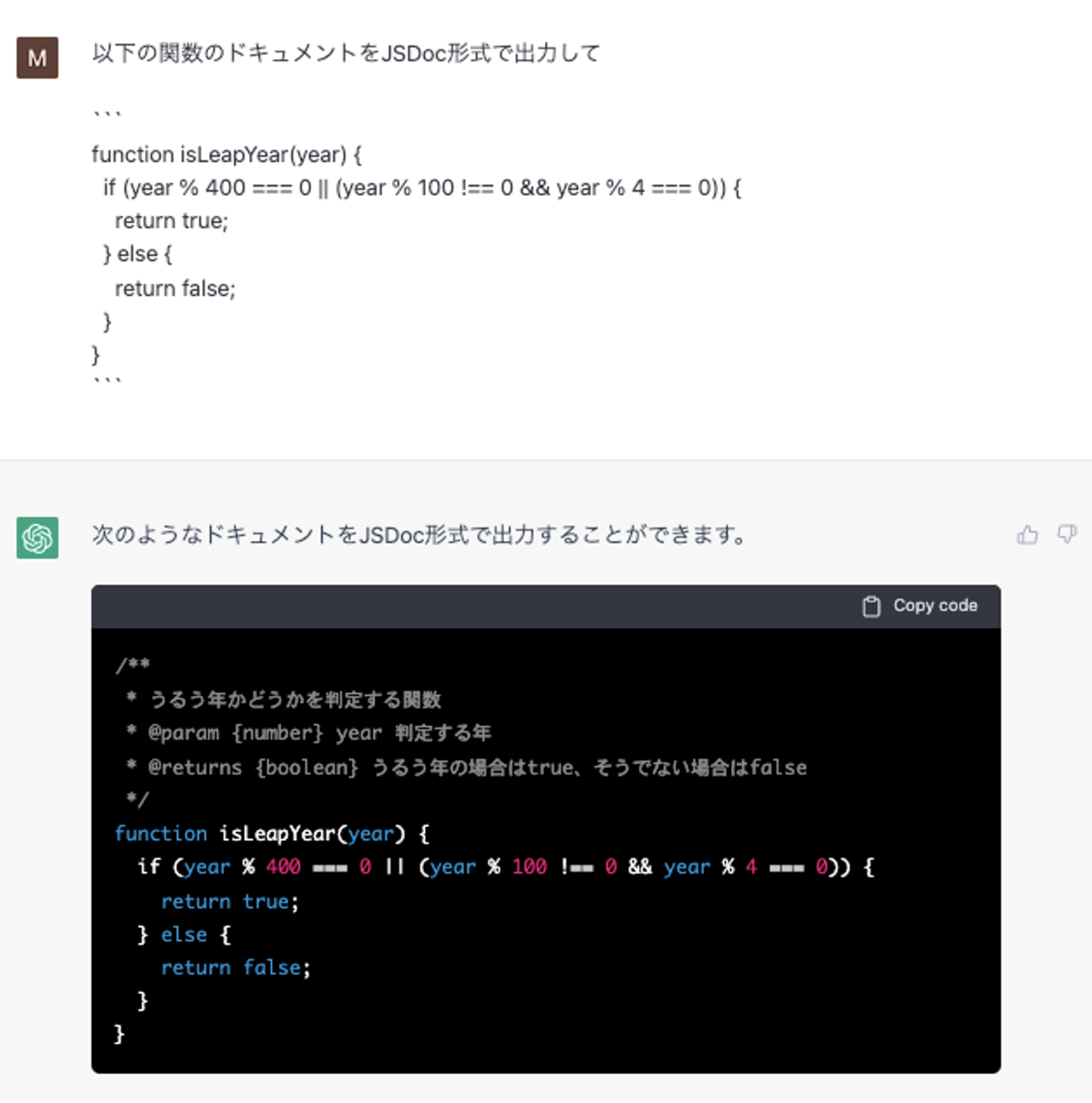

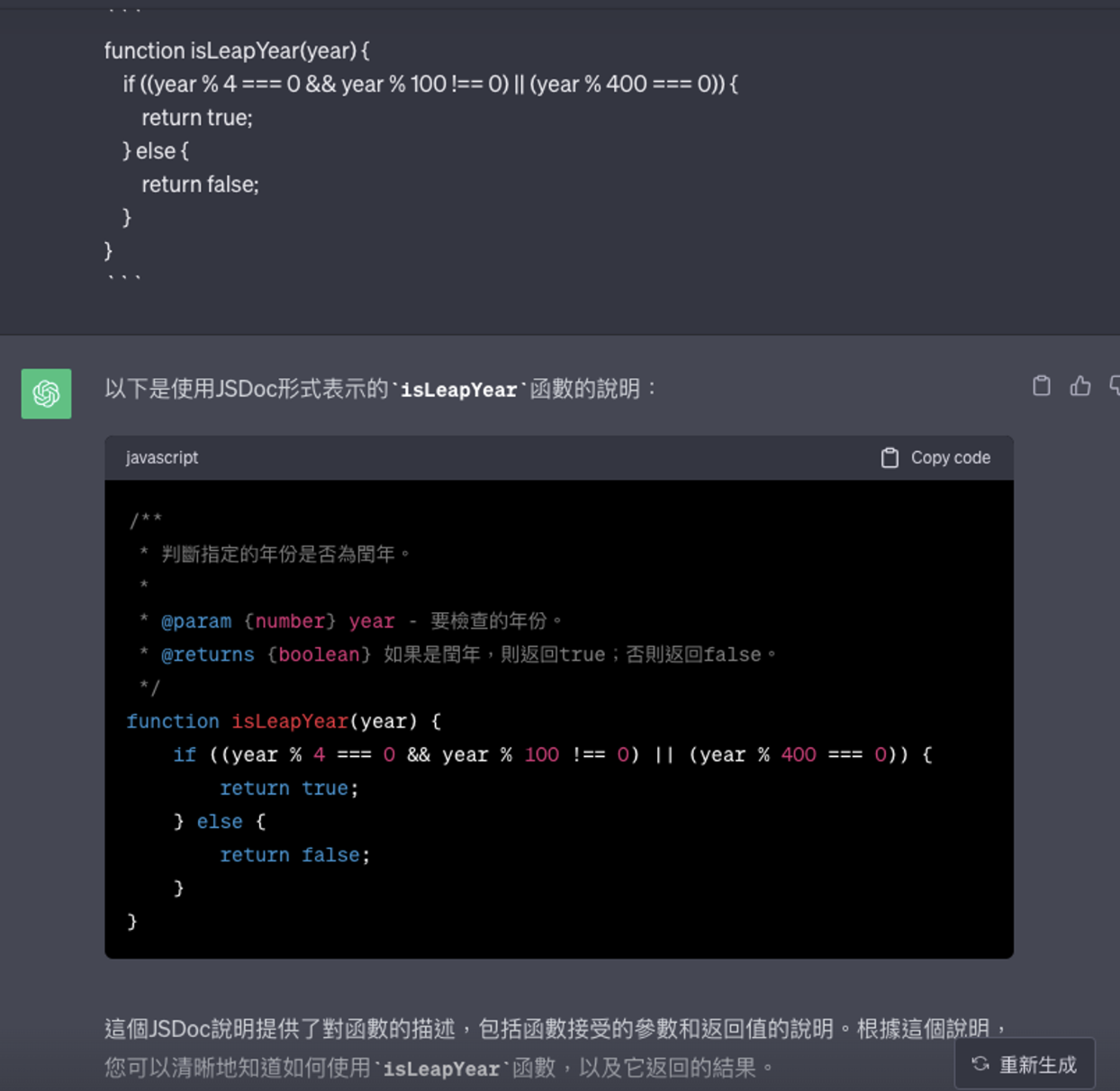

生成程式碼的文件

1 | 以下の関数のドキュメントをxx形式で出力して |

以下是中文版本:

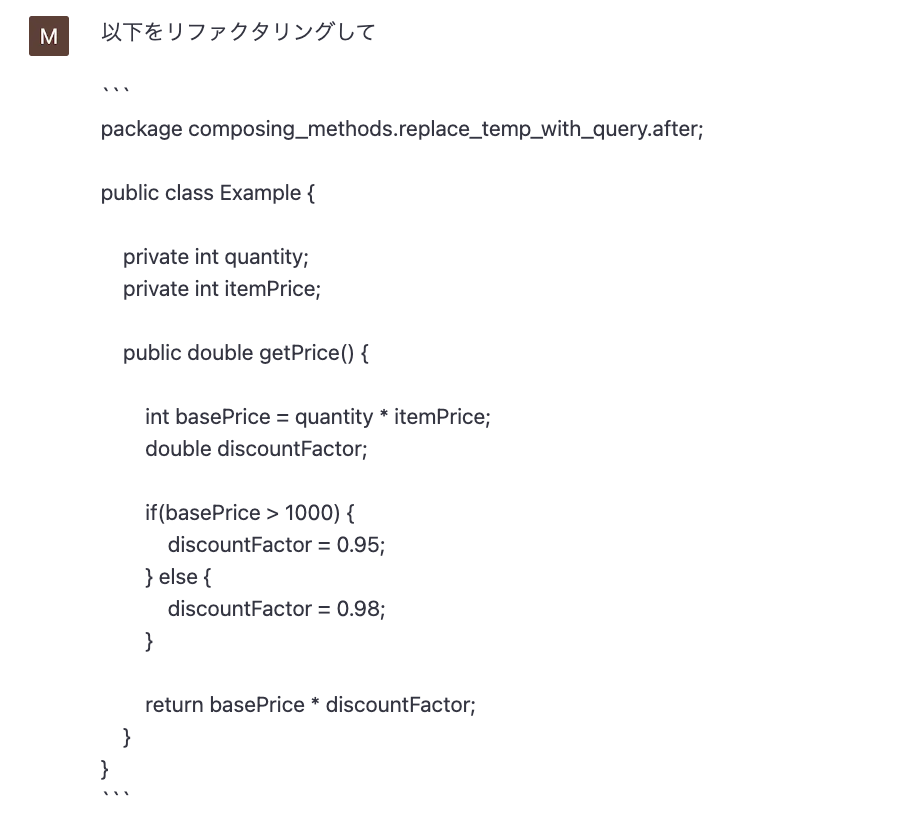

重構

以下程式碼的引用出處。

1 | 以下をリファクタリングして |

以下是中文版本:

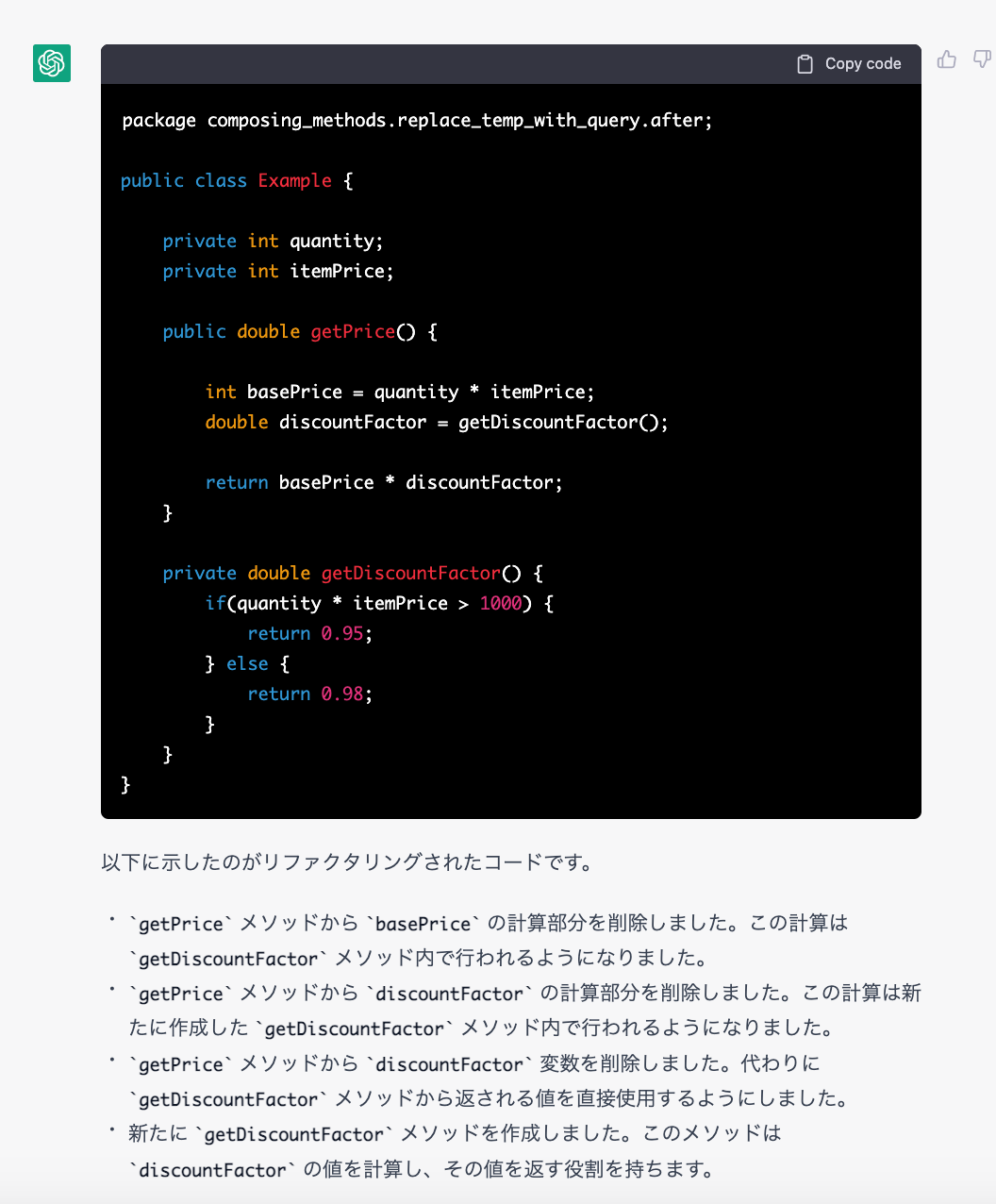

單元測試

1 | 以下の単体テストを書いて |

※ 第二項測試的 expected 有誤,因為 900*0.98 = 882 才正確,需注意由 AI 產出的測試程式碼也必須經過測試。

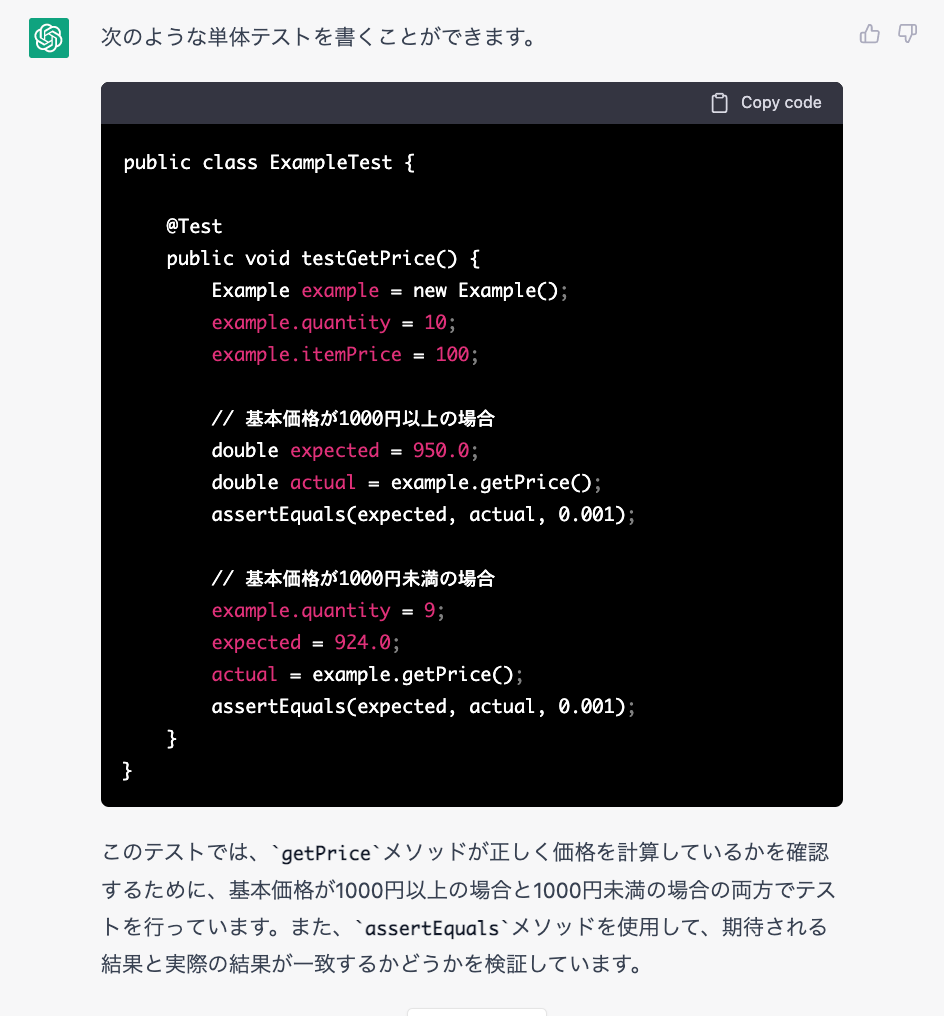

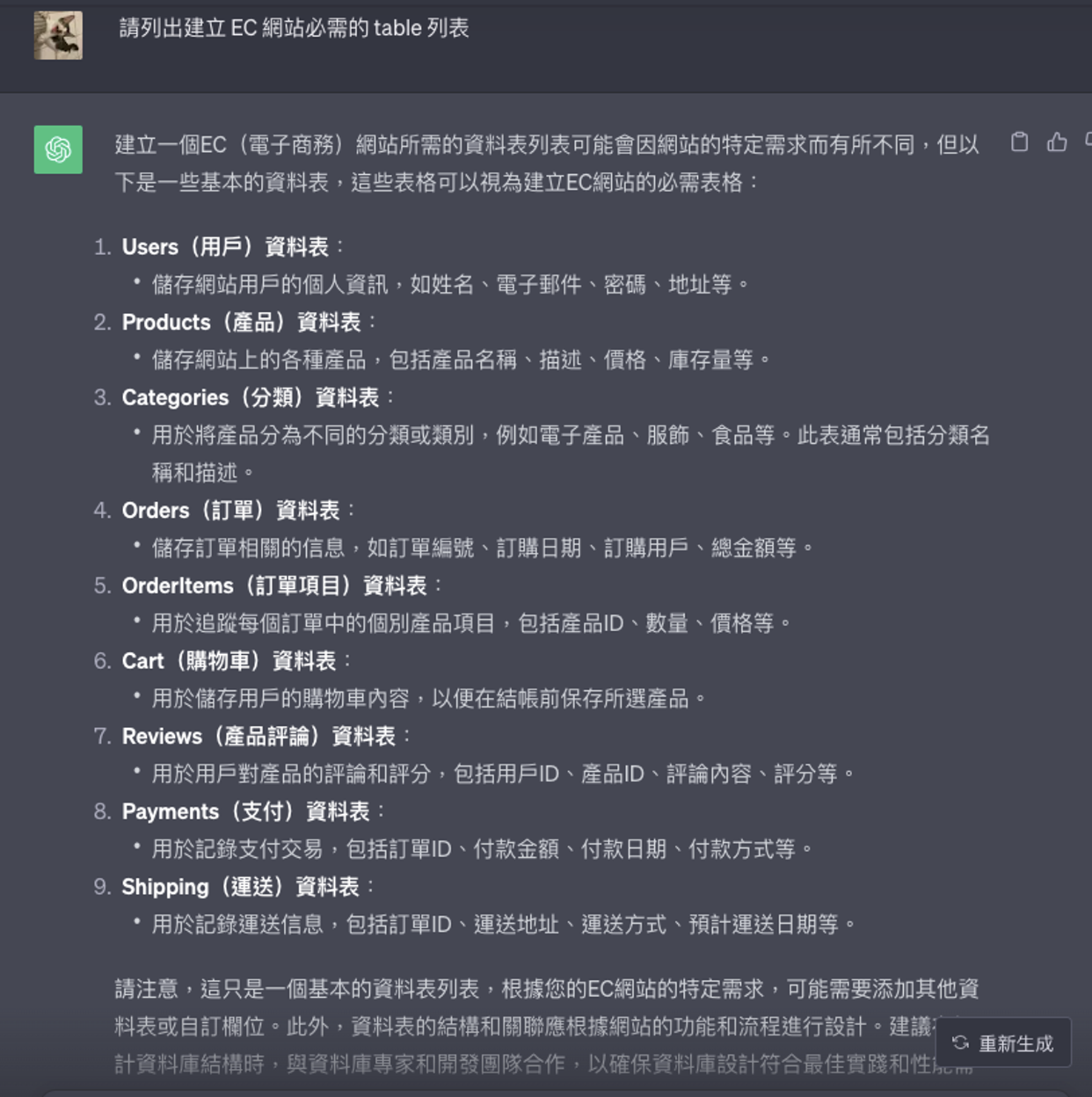

DB 設計(資料庫設計)

1 | 〜に必要なtable一覧を出力して |

以下是中文版本:

故事

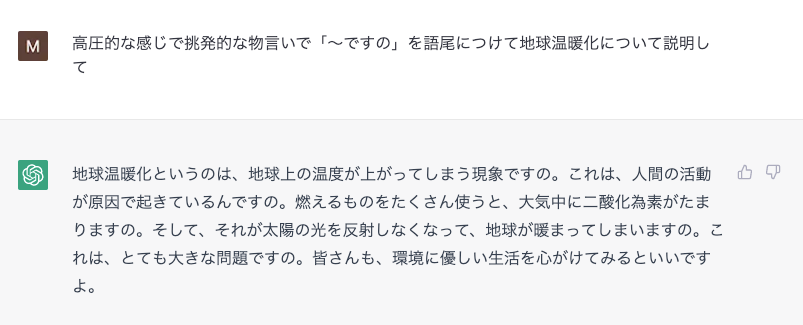

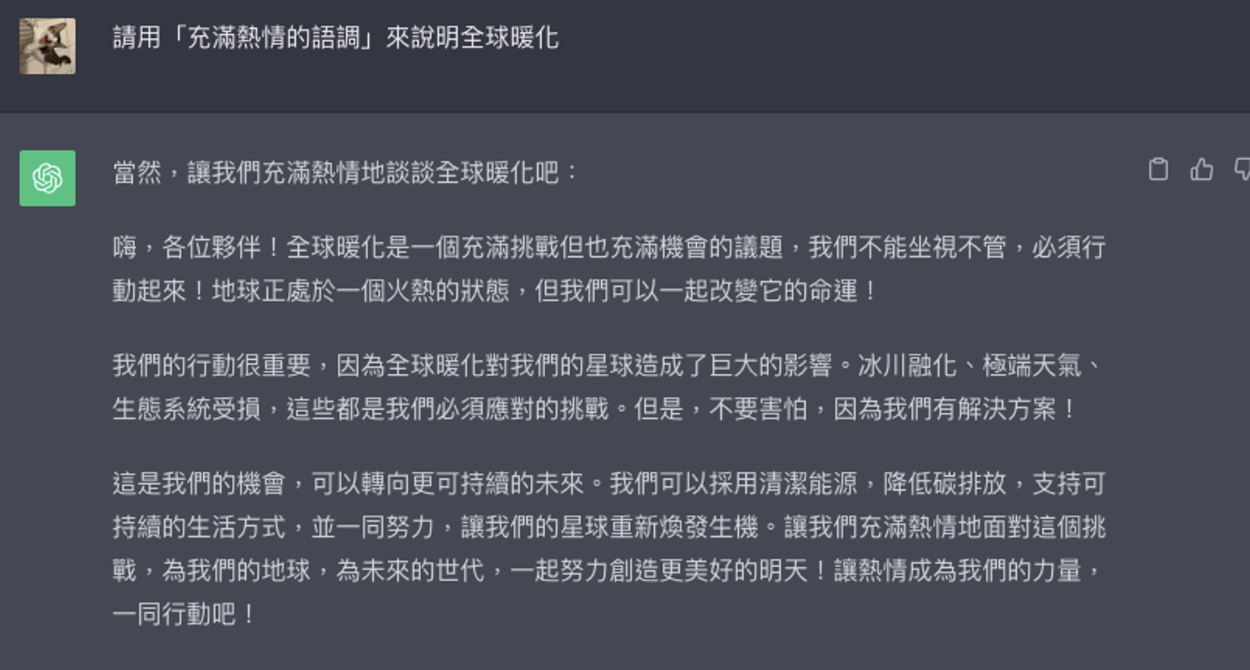

語氣變化

1 | 「〜ですの」を語尾につけてxxについて説明して |

也可以加上「用 ◯◯ 語調」、「用 ◯◯ 風格」等指令來表示。

以下是中文版本:

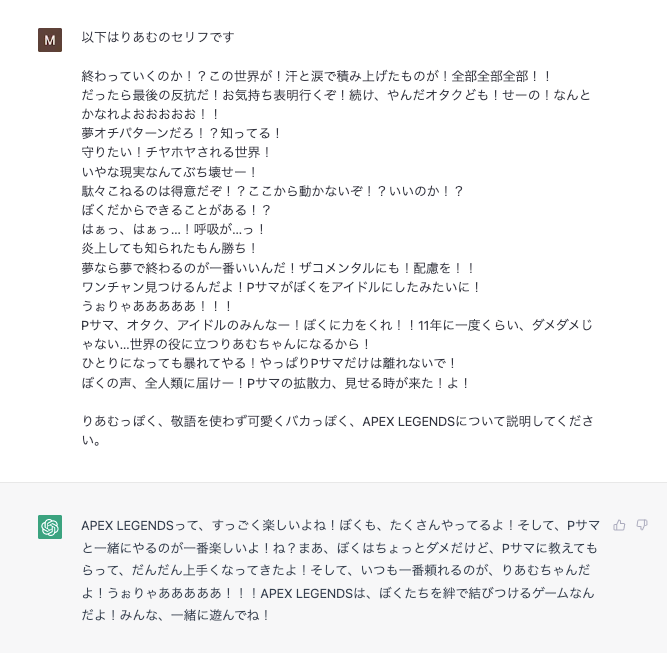

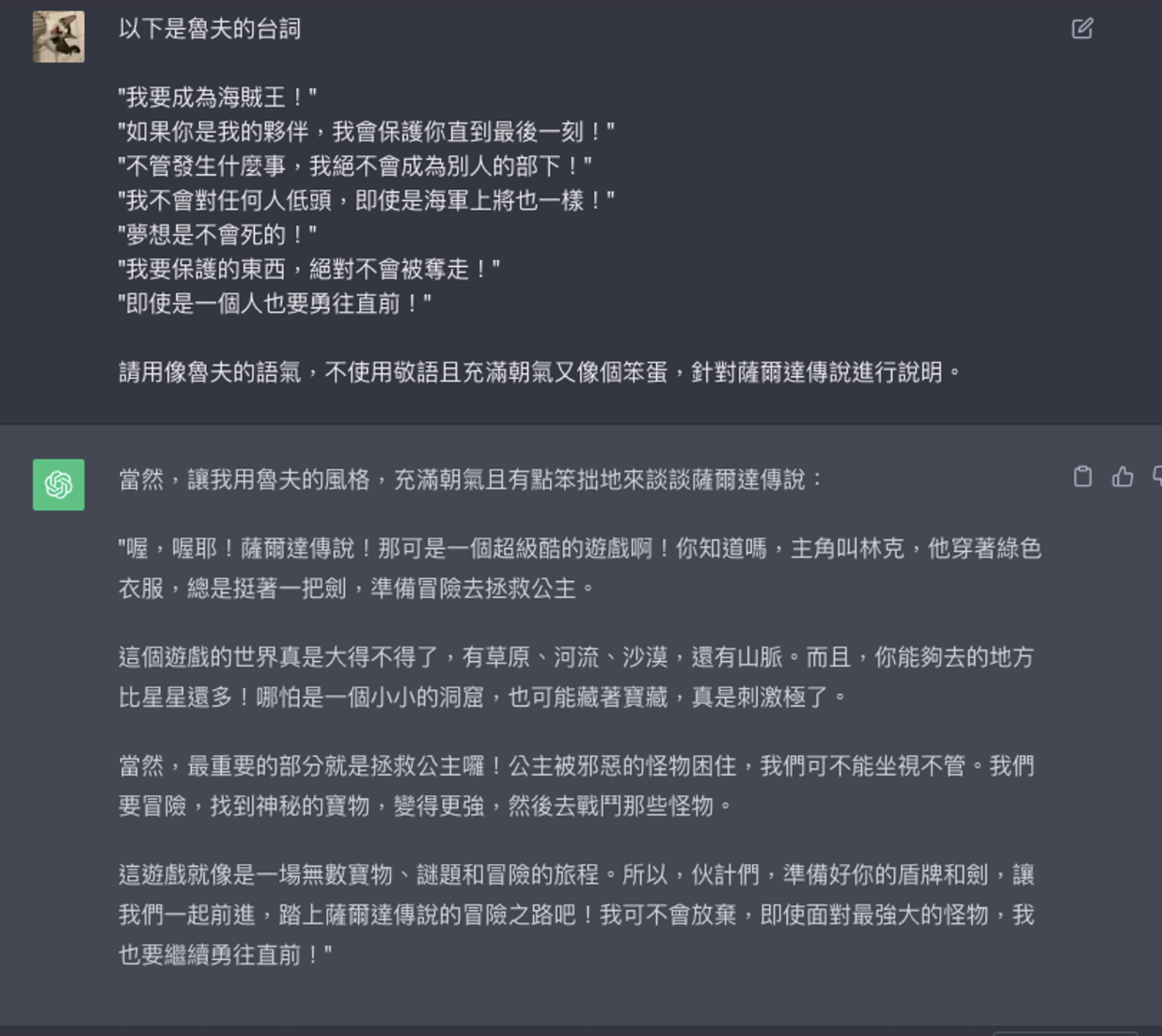

模仿角色的語氣來回答

1 | 以下はxxのセリフです |

以下是中文版本:

1 | [範例] 以下是魯夫的台詞 |

Bonus

GPT-3 的特性

- 可以做到

- 自動生成各種文件

- 用來回答問題

- 特徴

- 超厲害的馬可夫鏈(Markov chain)

- 使用一種稱為 Transformer 的架構(曾經成為熱門話題的 BERT 等也同樣是)

- 學習前文中詞語之間的關係模式

大規模語言模型

- Flan-U-PaLM(Google),540B(5400 億)類

- PaLM 學習 540B,Flan-PaLM 在其中進行 1.8k(1800)個任務學習的調整

- Gopher(Google / DeepMind),280B(2800 億)類

- Bloomz(bigscience),176B(1760 億)類

- https://huggingface.co/bigscience/bloomz

- GPT-3(OpenAI),175B(1750 億)類

- 提供方式:僅提供付費 API

- 授權:遵守 API 使用條款

- OPT-175B(Meta),175B(1750 億)類

- 提供方式:GitHub

- 授權:非營利性

- Galactica:120B(1200 億)類

- https://arxiv.org/abs/2211.09085

- https://galactica.org/

- 科學相關

- HyperCLOVA(LINE),82B(820 億)類

GPT-NeoX(EleutherAI):GPT-NeoX-20B,20B(200 億)類

GPT-J(EleutherAI):GPT-J-6B,6B(60 億)類- 提供方式:huggingface

- 授權:apache-2.0

- GPT-J-japanese-6.8B(Sta)

- https://huggingface.co/naclbit/gpt-j-japanese-6.8b

- (private)やみおとめ,20B(200 億)類

- japanese-gpt2-medium(Rinna),1.3B(13 億)類

References

- Chain of Thought Prompting Elicits Reasoning in Large Language Models

- 有關提高 GPT-3 在執行對話等方面性能的 Chain of Thought(CoT)方法的論文

- 作って理解する Transformer / Attention

- 闡述近期 DeepLearning 的超重要成果 Transformer 的好文章

15th鐵人賽目錄傳送門:https://ithelp.ithome.com.tw/users/20135558/ironman/6290